[Tech Review] 카메라로 구현한 유사 라이다(Pseudo LiDAR)

사람 없이 자동차 스스로 움직일 수 있도록 만들기 위해서는 다양한 기술과 장비가 필요하다.

가장 먼저 내가 어디에 있는지 알아야 한다. 이를 위해 IMU, INS 등이 포함된 고정밀 GPS가 필요하다. 이 신호를 바탕으로 정확한 위치 및 차로 등을 표시해줄 수 있는 고정밀 지도도 있어야 한다.

GPS와 지도가 있다고 끝이 아니다. 사람이 눈을 감으면 수m를 이동하기 힘들 듯, 자동차도 스스로 움직일 수 있으려면 주위를 볼 수 있어야 한다.

사람은 눈으로 주변 정보를 읽고 판단한다. 하지만 자동차는 조금 다른 방법으로 주위를 둘러본다. 카메라, 레이더, 라이다(LiDAR)로 구분된 센서가 그 핵심이다.

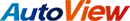

카메라는 영상을 바탕으로 주변 정보를 인식한다. 표지판이나 그림, 차선은 물론 색상 구분도 가능해 실제 사람의 눈 역할을 해준다. 하지만 빛의 세기를 비롯한 날씨, 오염 물질 등에 취약하다는 단점이 있다.

레이더는 전파를 사용해 주변을 인식한다. 눈, 안개 등 날씨의 영향을 잘 받지 않는다. 하지만 인식률이 매우 정밀하지 못하다는 한계가 있다. 작은 물체 감지 능력도 제한적이다.

라이다는 레이저 광선을 이용해 주변을 정밀하게 파악해주는 장치다. 카메라는 3차원 인식을 잘 하지 못하고 레이더는 주변은 파악해도 정밀하지 못하기 때문에 확실하게 주변을 보고 해석할 수 있는 역할을 해준다. 이제 자동차는 물론 스마트폰에도 적용되기 시작하면서 점차 보편화가 이뤄지고 있다.

라이다의 문제는 가격이다. 무인자동차에 해당하는 레벨 5 기준의 자율주행 자동차가 되기 위해서는 5~7개 정도의 라이다 센서가 필요하다. 최근 본격적으로 가격을 낮춘 라이다 센서가 양산되고 있다고 해도 자율주행차 완성을 위한 센서 구축을 위한 가격만 1~2천만원이 넘는다. 또 부피도 크다. 소형화가 이뤄졌음에도 아직은 지붕 위에 큰 장비들을 얹어야 한다.

그럼에도 자율주행자동차를 만들기 위해서는 라이다 센서를 사용해야한다. 이것이 대다수 자동차 업체들의 생각이다. 실제로 구글 웨이모, GM 크루즈, 포드 등 자율주행차 기술을 선도하고 있는 기업들이 라이다 센서를 중점적으로 활용하고 있다. 이중 웨이모는 라이다 센서 가격을 낮추겠다며 직접 라이다 제작을 알리기도 했다.

여기에 반기를 드는 업체가 있다. 바로 테슬라다. 테슬라는 카메라만 활용해 자율주행 기술을 활용하고 있다. 특히 라이다는 필요 없다는 말까지 했을 정도로 카메라 시스템을 신뢰하고 있다. 그리고 이와 관련된 신기술을 내놓겠다고 공언해왔다.

테슬라가 그 결과물을 2020 MLC(Machine Learning Conference 2020)발표했다. 라이다는 아니지만 라이다와 같은 수준의 정확도를 갖는 센서라는 의미로 ‘유사 라이다(Pseudo LiDAR)’라는 이름을 붙였다.

유사 라이다는 카메라를 사용한다. 라이다를 사용하지 않으며, 고정밀 지도조차 사용하지 않는다. 사람이 눈으로 보면서 운전을 하듯, 자동차도 눈(카메라)으로 본대로 상황을 인식하고 스스로 운전을 할 수 있도록 개발됐다.

유사 라이다는 기존 라이다 센서가 알 수 없는 부분까지 확인과 해석이 가능하다. 교차로에 진입하면 왼쪽에서 오는 차, 오른쪽에서 오는 차, 보행자는 어디에 있는지, 표지판은 뭐라고 하는지, 신호등은 어떤 상태인지 한번에 읽고 판단이 가능하다.

그렇다면 라이다 센서 없이 어떻게 화면 속 정보를 정확하게 판단할 수 있는 것일까?

가장먼저 중요한 요소는 신경망 네트워크(Neural Network)의 활용이다. 사람의 뇌를 모방한 신경망 네트워크는 인공지능 시스템이 스스로 학습할 수 있는 딥러닝 기술을 활용할 수 있다. 이중 CNN(Convolutional Neural Network)은 자율주행차에 있어서 핵심적인 기술로 분류된다.

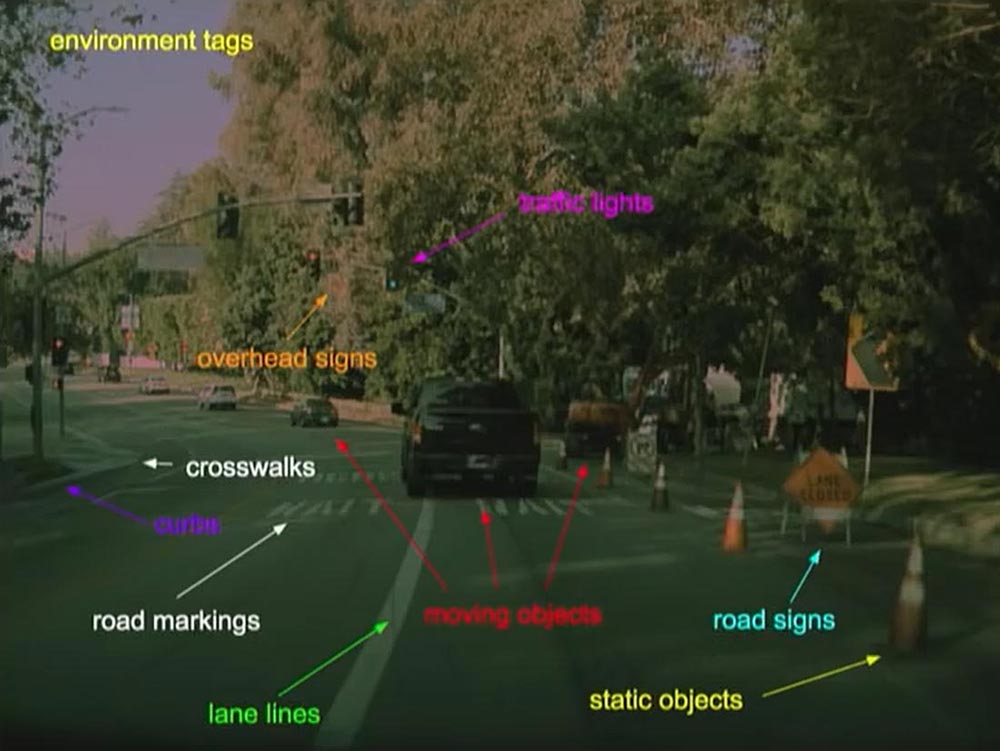

예를 들어 정지 표지판을 인식해야 한다고 생각해보자. 사실 정상적으로 잘 보이는 정지 표지판보다 잘 안보이는 정지 표지판이 더 많다. 나뭇잎에 가려지거나 기울어진 상태로 있을 수 있고 공사를 위해 임시로 설치할 수 있으며, 자동차에 가려져 부분만 보일 수 있다. 거꾸로 설치될 수도 있으며, 기차 선로에 있는 것처럼 움직이는 막대에 부착된 정지 표지판도 있을 수 있다.

사람은 정지 표시가 어떻게 설치되었건 바로 알아볼 수 있다. 하지만 컴퓨터는 이것을 이해할 수 없다. 때문에 다양한 환경에서 반복을 통해 스스로 학습하고, 표지판이 부분적으로 보이더라도 추측해서 인식할 수 있어야 한다.

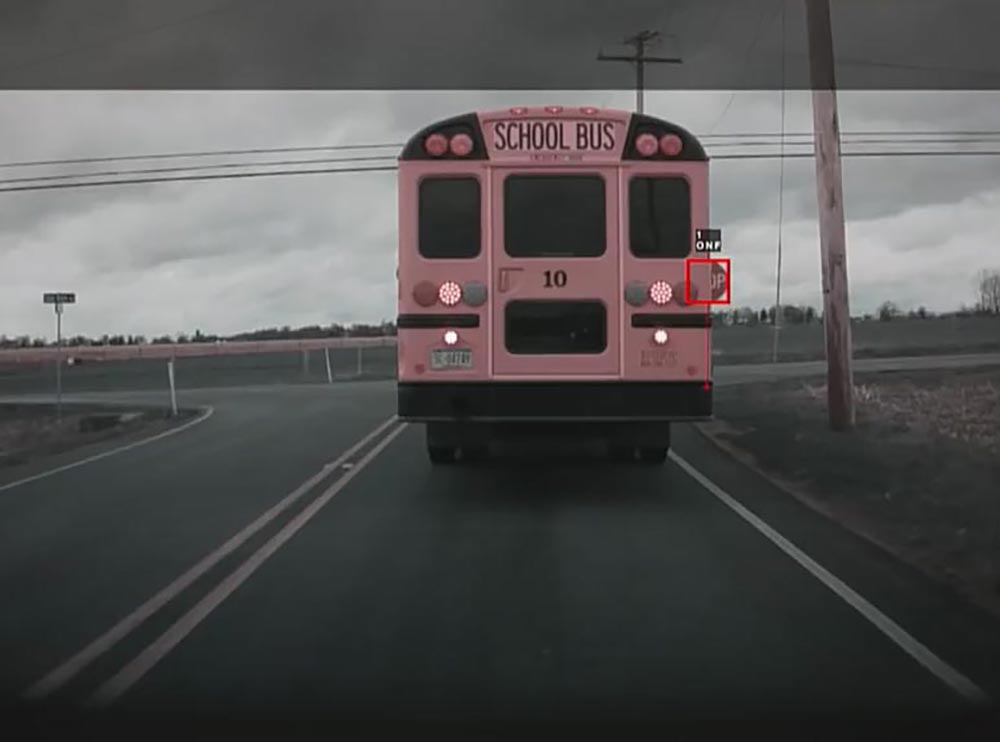

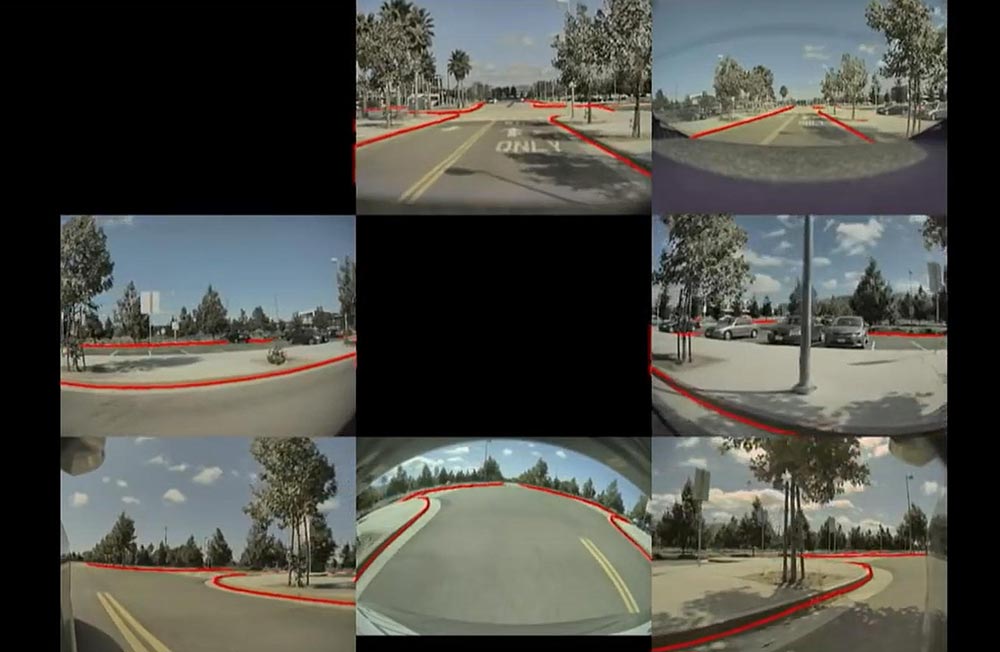

기본적으로 자동차는 스스로 주행하면서 정확하게 인지할 수 없는 상황을 매우 많이 접하게 된다. 이때 차량은 여러 방향에 장착된 카메라 정보를 통합적으로 파악하고 이것을 스스로 분석한다. 그리고 정확한 데이터를 다시 차량에 적용시켜 완성도를 높인다.

테슬라는 이러한 방식으로 눈 비 환경, 가려진 환경, 디지털 표지판, 기울어진 환경 등 악조건 속에서 정지 표지판 인식률을 99.51%까지 높였다고 밝혔다.

이러한 방식으로 사물에 대한 인식률을 높였다고 해도 한가지 걸림돌이 존재한다. 바로 2차원적으로 인식할 수밖에 없는 카메라를 어떻게 3차원적으로 인식하게 만드느냐다.

예를 들어 긴 직선 도로가 있다고 가정하자. 저 멀리 지평선까지 연결되어 있을 정도로 말이다. 사람은 그동안의 경험과 3차원적으로 인식하는 눈을 통해 지평선과 도로를 구분할 수 있다. 하지만 카메라는 그렇게 인식을 못한다.

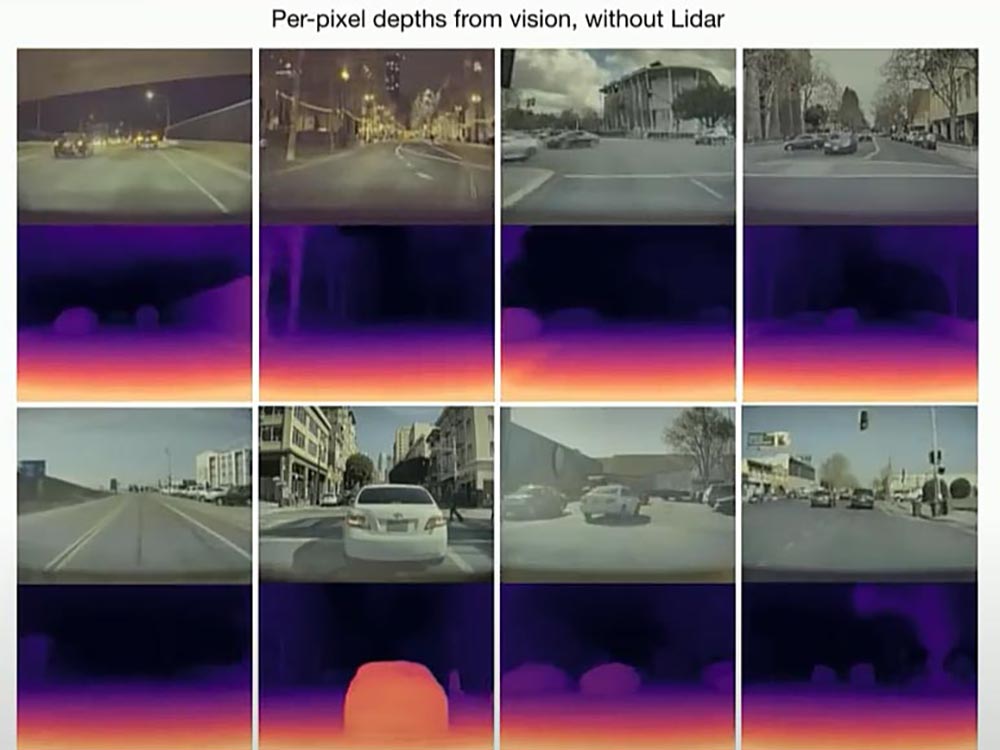

이러한 한계를 극복하기 위해 사용한 방법이 바로 픽셀을 응용한 것이다. 영상을 통해 인식된 화면 픽셀을 하나하나 깊이를 예측하는 것이다. 1개의 픽셀이 1개의 라이다 신호라고 생각하도록 처리하는 방식인 것. 그리고 이것을 3차원으로 표현하면 라이다 센서가 없지만 라이다를 활용한 것처럼 주변 상황을 인식하게 만들 수 있다. 3차원으로 인식하는 것이 가능해지면 자동차 스스로 학습하는 딥러닝까지 가능하다.

카메라만으로 라이다에 준하는 주변 인식이 가능해지면 자동차가 처리해야하는 정보는 크게 줄어든다. GPS+맵데이터+라이다+레이더+카메라 조합에서 처리해야하는 정보가 극단적으로는 카메라+레이더 정도의 정보로 줄어들기 때문이다. 간단하고 직관적이며 비용도 적게 드는 방법이다.

물론 한계는 있다. 영상 이미지를 픽셀 단위로 해석하는 것이 가능한 고성능 컴퓨터가 필요하다. 또, 아직까지는 라이다 센서와 100% 동일한 성능을 구현할 수는 없다. 이를 위해 3세대 자율주행 컴퓨터를 테슬라가 직접 개발해 유사 라이다 소프트웨어의 완성도를 높이는 방법을 선택했다.

물론 아직 어디까지나 유사 라이다는 유사 라이다다. 실제 라이다를 대체할 수는 없으며, 라이다 센서의 성능을 넘어서지 못했다. 때문에 아직까지는 자율주행 기술의 주류가 되지 못한다는 의견도 있다.

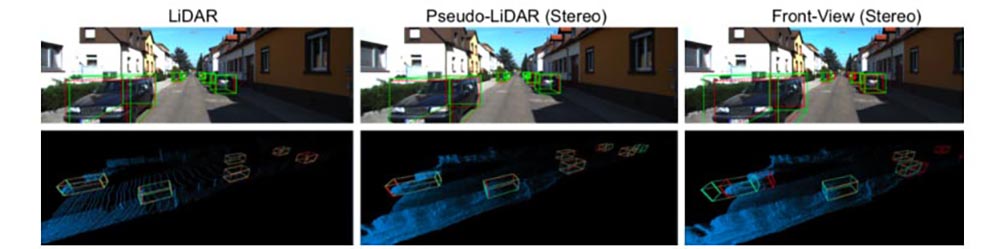

하지만 그 격차가 상당히 빠른 속도로 줄어들고 있다. 미국 코넬 대학교의 연구 결과도 긍정적이다. 실제 라이다 센서가 주위를 인식한 것과 카메라를 사용한 유사 라이다가 주위를 인식한 결과가 거의 비슷한 것으로 확인됐기 때문이다.

대다수 자동차 및 기술 회사들이 생각하는 라이다가 자율주행 자동차의 중심이 될까, 아니면 일론 머스크의 유사 라이다 기술이 자율주행 시장을 뒤엎게 될까? 미래 자동차 기술이 한치 앞도 알 수 없는 국면으로 접어들고있다.